接下来我将会讲解github上分步手动搭建流程。

上面忘记讲了,现在补充一下

首先你需要安装Conda或者WSL

这里的话我就不具体讲解如何安装了,b站教程很多,大家自己学习一下就行。

以下我将会以安装了conda虚拟环境的方式继续

首先创建虚拟环境:

conda create -n textgen python=3.10.9

激活conda

conda activate textgen

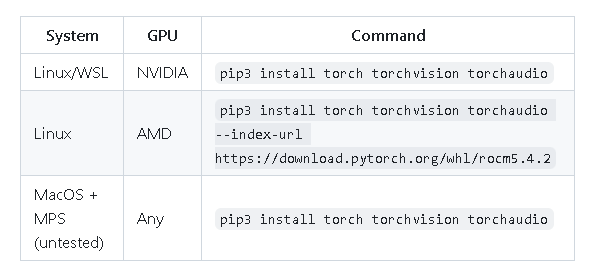

然后根据你的系统,安装Pytorch

然后安装oobabooga

![]()

cd进入文件夹

cd text-generation-webui

安装依赖

pip install -r requirements.txt

等待依赖跑完就算安装完成了。

更多细节请前往github页面:GitHub - oobabooga/text-generation-webui: A gradio web UI for running Large Language Models like LLaMA, llama.cpp, GPT-J, Pythia, OPT, and GALACTICA.